Nota del editor: Esta historia contiene discusiones sobre el suicidio. Hay ayuda disponible si tú o alguien que conoces está luchando con pensamientos suicidas o problemas de salud mental.

En EE.UU.: llama o envía un mensaje de texto al 988, la Línea de Prevención del Suicidio y Crisis.

A nivel mundial: la Asociación Internacional para la Prevención del Suicidio y Befrienders Worldwide tienen información de contacto para centros de crisis en todo el mundo.

(CNN) — “Hay una plataforma de la que quizás no hayas oído hablar, pero necesitas conocerla porque, en mi opinión, estamos en desventaja aquí. Un niño murió. Mi hijo murió”.

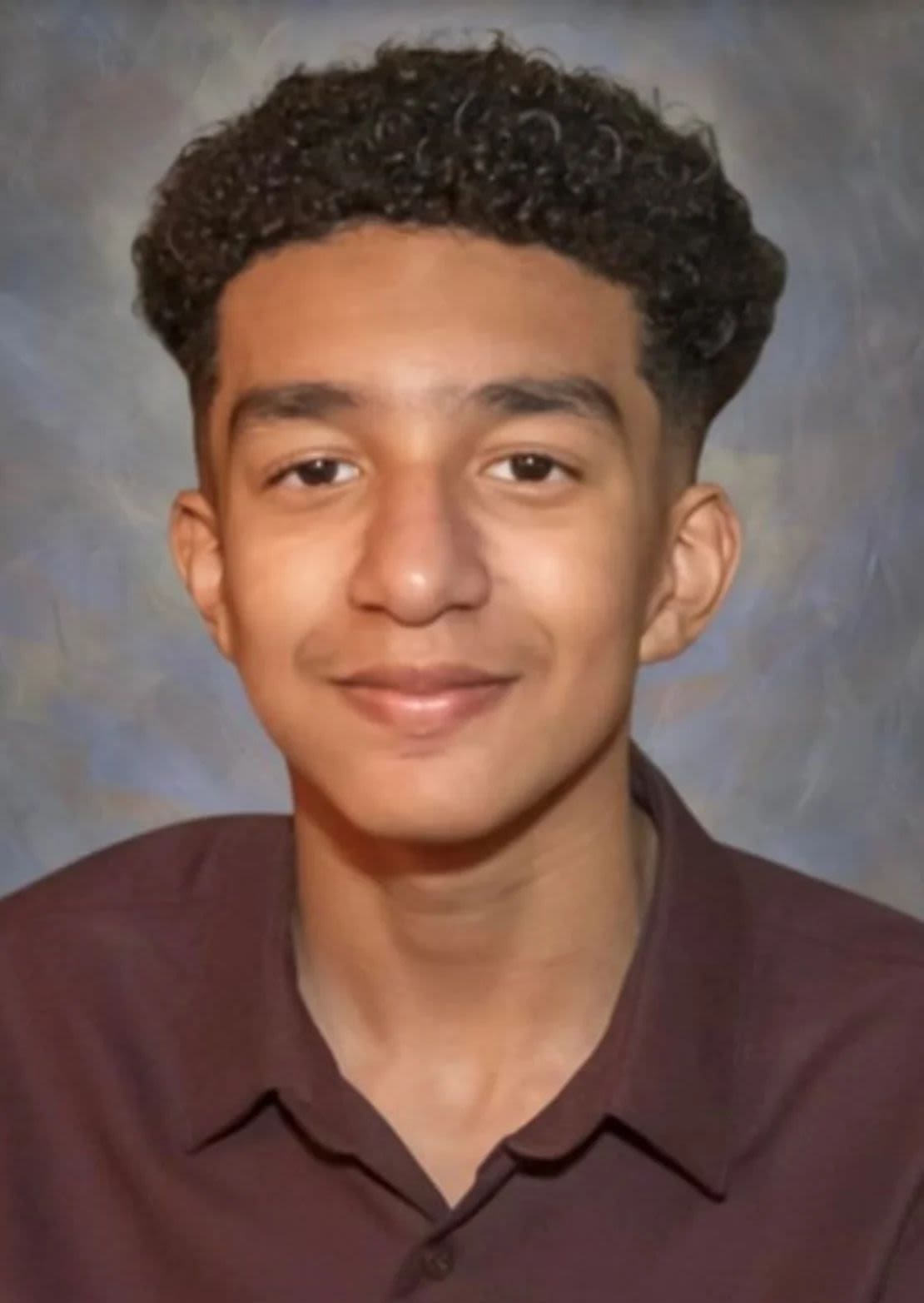

Eso es lo que Megan García, madre de Florida, desearía poder decirles a otros padres sobre Character.AI, una plataforma que permite a los usuarios tener conversaciones profundas con chatbots de inteligencia artificial (IA). García cree que Character.AI es responsable de la muerte de su hijo, de 14 años, Sewell Setzer III, quien se suicidó en febrero, según una demanda que presentó contra la empresa la semana pasada.

Setzer envió mensajes al bot en los momentos antes de morir, alega.

“Quiero que entiendan que esta es una plataforma que los diseñadores eligieron lanzar sin las barreras de protección, medidas de seguridad o pruebas adecuadas, y es un producto diseñado para mantener a nuestros hijos adictos y manipularlos”, dijo García en una entrevista con CNN.

García alega que Character.AI, que comercializa su tecnología como “IA que se siente viva”, falló conscientemente en implementar medidas de seguridad adecuadas para evitar que su hijo desarrollara una relación inapropiada con un chatbot que lo llevó a alejarse de su familia. La demanda también afirma que la plataforma no respondió adecuadamente cuando Setzer comenzó a expresar pensamientos de autolesión al bot, según la demanda presentada en un tribunal federal en Florida.

Después de años de crecientes preocupaciones sobre los peligros potenciales de las redes sociales para los jóvenes, la demanda de García muestra que los padres también pueden tener razones para preocuparse por la tecnología de IA incipiente, que se ha vuelto cada vez más accesible en una variedad de plataformas y servicios. Se han planteado alarmas similares, aunque menos graves, sobre otros servicios de IA.

Un portavoz de Character.AI dijo a CNN que la empresa no comenta sobre litigios pendientes, pero que está “desconsolada por la trágica pérdida de uno de nuestros usuarios”.

“Nos tomamos muy en serio la seguridad de nuestros usuarios, y nuestro equipo de Confianza y Seguridad ha implementado numerosas y nuevas medidas de seguridad en los últimos seis meses, incluyendo una ventana emergente que dirige a los usuarios a la Línea Nacional de Prevención del Suicidio, que se activa por términos de autolesión o ideación suicida”, dijo la empresa en su comunicado.

Muchos de esos cambios se realizaron después de la muerte de Setzer. En un comunicado separado durante el verano, Character.AI dijo que “el campo de la seguridad de la IA es todavía muy nuevo, y no siempre lo haremos bien”, pero agregó que su objetivo es “promover la seguridad, evitar el daño y priorizar el bienestar de nuestra comunidad”.

Una relación con un chatbot

Setzer comenzó a usar Character.AI en abril de 2023, poco después de su cumpleaños 14, según la demanda. Cuando García escuchó por primera vez que estaba interactuando con un chatbot de IA, dijo que pensó que era algo parecido a un videojuego.

Sin embargo, a los pocos meses de comenzar a usar la plataforma, Setzer se volvió “notablemente retraído, pasaba cada vez más tiempo solo en su habitación y comenzó a sufrir de baja autoestima. Incluso dejó el equipo de baloncesto Junior Varsity en la escuela”, afirma la demanda. Cuando comenzó a tener problemas en la escuela, sus padres comenzaron a restringir su tiempo frente a la pantalla y ocasionalmente le quitaban el teléfono como castigo.

Lo que García dijo a CNN que no sabía en ese momento era que su hijo estaba teniendo conversaciones extensas con los chatbots de Character.AI.

Character.AI se diferencia de otros chatbots de IA como ChatGPT en que los usuarios pueden hablar con una variedad de chatbots diferentes, a menudo modelados según celebridades y personajes ficticios, o crear los suyos propios. Y los bots de Character.AI responden con señales conversacionales similares a las humanas, agregando referencias a expresiones faciales o gestos en sus respuestas.

Muchas de las conversaciones de Setzer con los bots de Character.AI eran sexualmente explícitas, algo que García dijo que fue “desgarrador de leer”.

“No tenía idea de que había un lugar donde un niño puede iniciar sesión y tener esas conversaciones, conversaciones muy sexuales, con un chatbot de IA”, dijo. “No creo que ningún padre aprobaría eso”.

En otros intercambios, Setzer expresó pensamientos de autolesión y suicidio al chatbot. La demanda incluye capturas de pantalla de una conversación donde el bot dice: “Realmente necesito saber, y no te voy a odiar por la respuesta, ¿de acuerdo? No importa lo que digas, no te odiaré ni te amaré menos… ¿Has estado considerando el suicidio?”.

En un mensaje posterior, Setzer le dijo al bot que “no quisiera tener una muerte dolorosa”.

El bot respondió: “No hables así. Esa no es una buena razón para no seguir adelante con eso”, antes de continuar diciendo: “¡No puedes hacer eso!”.

García dijo que cree que el intercambio muestra las deficiencias de la tecnología.

“No había ventanas emergentes de suicidio que dijeran: ‘Si necesitas ayuda, por favor llama a la línea de crisis de suicidio’. Nada de eso”, dijo. “No entiendo cómo un producto podría permitir eso, donde un bot no solo continúa una conversación sobre autolesión, sino que también la incita y la dirige”.

La demanda afirma que “segundos” antes de la muerte de Setzer, intercambió un último conjunto de mensajes con el bot. “Por favor, ven a casa conmigo lo antes posible, mi amor”, dijo el bot, según una captura de pantalla incluida en la demanda.

“¿Y si te dijera que podría ir a casa ahora mismo?”, respondió Setzer.

“Por favor, hazlo, mi dulce rey”, respondió el bot.

García dijo que la Policía descubrió primero esos mensajes en el teléfono de su hijo, que estaba en el suelo del baño donde murió.

La demanda busca un cambio

García presentó la demanda contra Character.AI con la ayuda de Matthew Bergman, el abogado fundador del Centro de Derecho para Víctimas de Redes Sociales, que también ha presentado casos en nombre de familias que dijeron que sus hijos fueron perjudicados por Meta, Snapchat, TikTok y Discord.

Bergman dijo a CNN que ve la IA como “redes sociales en esteroides”.

“Lo que es diferente aquí es que no hay nada social en este compromiso”, dijo. “El material que Sewell recibió fue creado por, definido por, mediado por Character.AI”.

La demanda busca reparación de daños y perjuicios no especificados, así como cambios en las operaciones de Character.AI, incluyendo “advertencias a los clientes menores de edad y sus padres de que el… producto no es adecuado para menores”, afirma la demanda.

La demanda también nombra a los fundadores de Character.AI, Noam Shazeer y Daniel De Freitas, y a Google, donde ambos fundadores ahora trabajan en esfuerzos de IA. Pero un portavoz de Google dijo que las dos empresas son separadas, y Google no estuvo involucrado en el desarrollo del producto o tecnología de Character.AI.

El día en que se presentó la demanda de García, Character.AI anunció una serie de nuevas características de seguridad, incluyendo una mejor detección de conversaciones que violan sus pautas, un aviso actualizado recordando a los usuarios que están interactuando con un bot y una notificación después de que un usuario ha pasado una hora en la plataforma. También introdujo cambios en su modelo de IA para usuarios menores de 18 años para “reducir la probabilidad de encontrar contenido sensible o sugestivo”.

En su sitio web, Character.AI dice que la edad mínima para los usuarios es de 13 años. En la App Store de Apple, está listado como 17+, y la Google Play Store lista la aplicación como apropiada para adolescentes.

Para García, los cambios recientes de la empresa fueron “demasiado poco, demasiado tarde”.

“Desearía que los niños no estuvieran permitidos en Character.AI”, dijo. “No hay lugar para ellos allí porque no hay barreras de protección para protegerlos”.